New

Marketowi

Zasilać swoją drużyny do stworzenia filmów

w skali

Tworzycy

Ułatwiły budowę obecności społecznej

Agencja

Skalowy produkcja wideo z

Easy

WAN 2.2 – modelem wideo generacyjnego otwartego koda z Akademii Damo w Alibabi, publicznie wydany 28 lipca 2025 r. Wprowadza on architekturę mieszanego ekspertu (MoE) do modelu rozpowszechniania wideo, co znacznie poprawiła zdolność i wykonywanie modelu bez zwiększenia kosztów wyników. Model jest znaczny z powodu estetyki na poziomie filmowej, wyjścia wysokiej definicji 1080p oraz zdolności do generowania złożonego ruchu płynnego z większą kontrolowaną niż poprzednich

WAN 2.2 – modelem wideo generacyjnego otwartego koda z Akademii Damo w Alibabi, publicznie wydany 28 lipca 2025 r. Wprowadza on architekturę mieszanego ekspertu (MoE) do modelu rozpowszechniania wideo, co znacznie poprawiła zdolność i wykonywanie modelu bez zwiększenia kosztów wyników. Model jest znaczny z powodu estetyki na poziomie filmowej, wyjścia wysokiej definicji 1080p oraz zdolności do generowania złożonego ruchu płynnego z większą kontrolowaną niż poprzednich

Tworzy złożone, płynne i naturalne ruchy w filmach, poprawiając realizm i spójność.

Szkolony na szczególnie kurowanych danych, aby produkować filmy z dokładną kontrolowaniem nad oświetleniem, kolorem i kompozicją.

Generuje filmy o rozdzielnieniu 1080p o 24fps, odpowiednie do profesjonalnego użycia.

Kontrola kamery filmowej Generuje filmy o rozdzielnieniu 1080p o 24fps, odpowiednie do profesjonalnego użycia.

Tworzy bezszczęśliwe przejście filmu poprzez interpolację pomiędzy określonym ramem

Dostępny jest wysokościowe model 5B, który może pracować na GPU konsumentów jak RTX 4090.

Model jest publicznie dostępny, pozwala na dokładną dostosowanie z LORA i innymi narzędzi opracowanych przez wspólnoty.

Oto trzy proste kroki, które pomogą ci badać WAN 2.2 na Vizard:

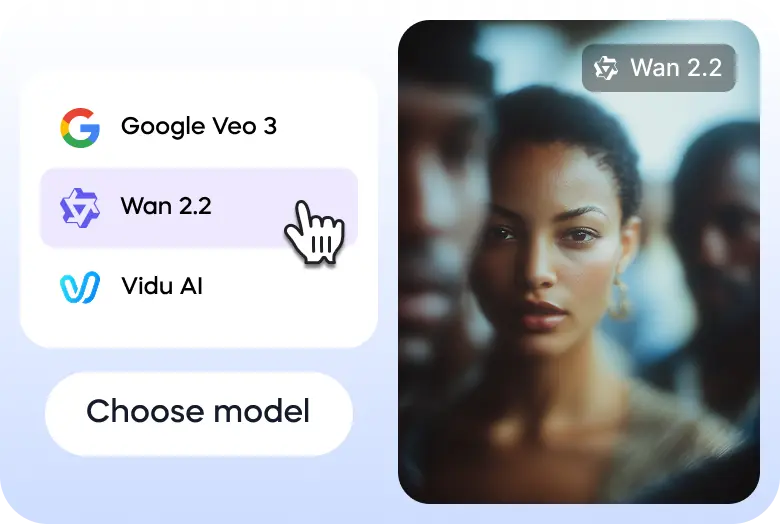

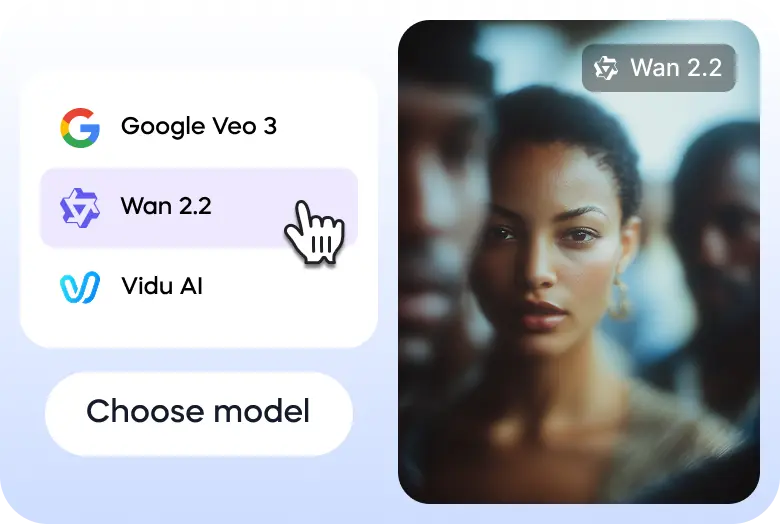

Idź do tekstu Vizard do generator video i wybierz model WAN 2.2.

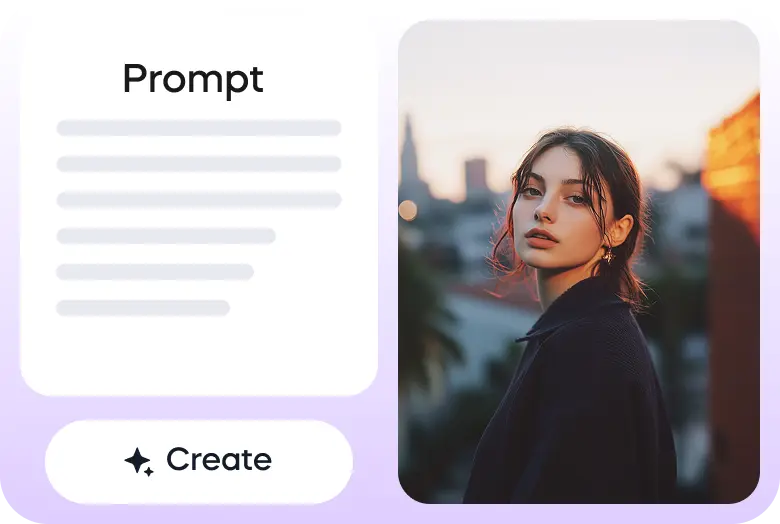

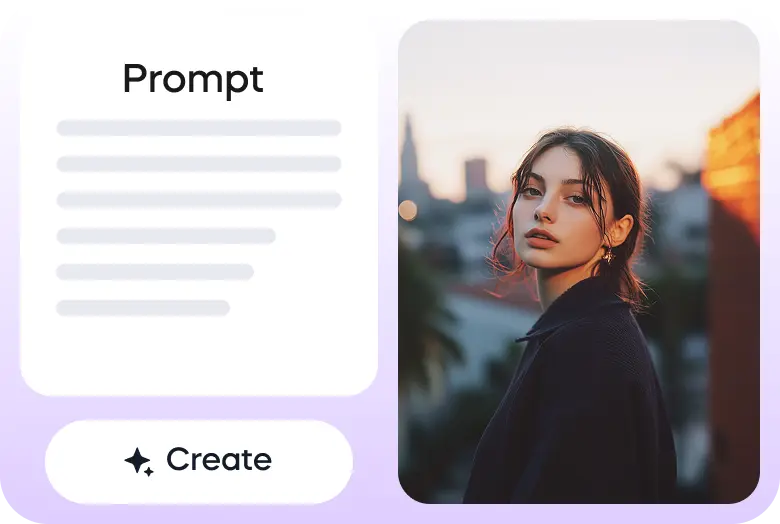

Wedłuż swój proszę lub złożć obraz, aby zacząć.

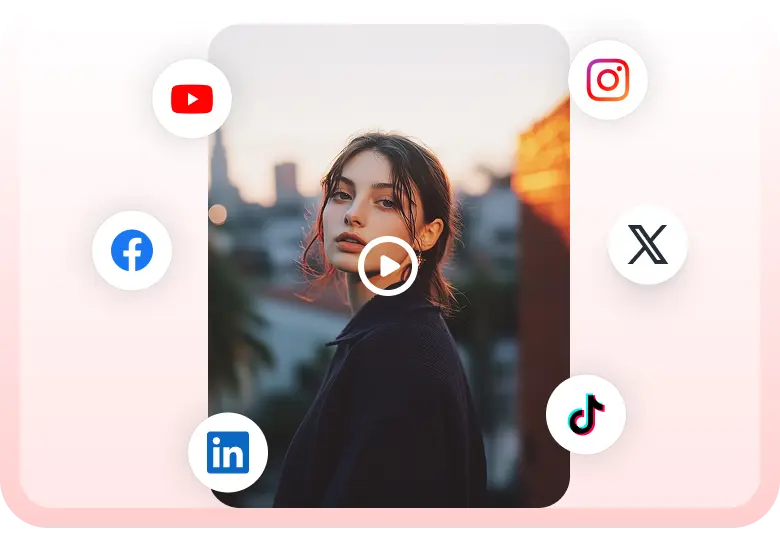

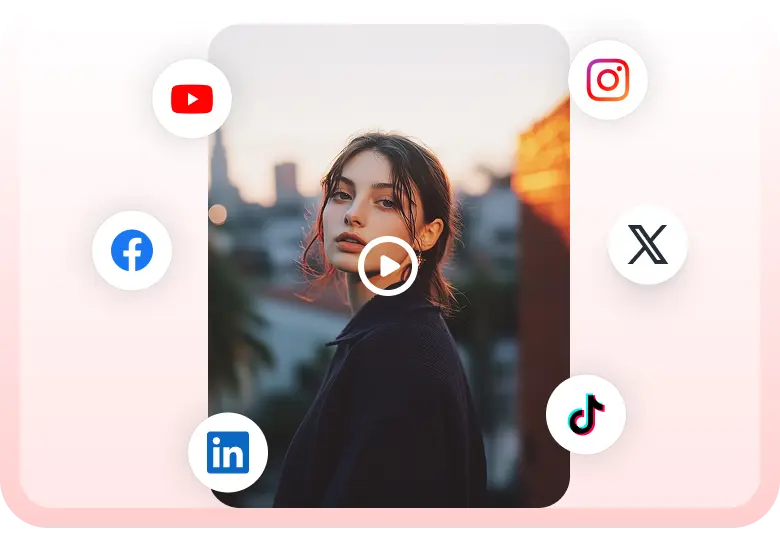

Po gotowie nagrania można go zawierać lub podzielić się na kontach społecznych bezpośrednio przez Vizard.

Wan2.2 The quality is significantly improved, tested some human body performance. Amazing@Alibaba_Wan #wan2.2 pic.twitter.com/ptUXlOS1Ka

— TTPlanet (@ttplanet) July 28, 2025

Fun workflow I was playing with last night

— A.I.Warper (@AIWarper) August 8, 2025

1) Kontext to remove Thor from the shot

2) Photopea to place Shrek

3) Kontext + Relight lora to blend him into the shot

4) Wan2.2 i2V to animate

Very addicting... 😍

Prompts are written up in the corner. Wan 2.2 prompt below 👇 pic.twitter.com/EnWE2OgA7T

Wan2.2(I2V) works pretty good.(Base image is not AI generated.) pic.twitter.com/5g9CfoiqT4

— Xiu Ran (@f_fanshu) July 30, 2025

You can’t skate here sir..

— Ingi Erlingsson 🪄 (@ingi_erlingsson) August 5, 2025

Wan2.2 @Alibaba_Wan + @ComfyUI 🛹 pic.twitter.com/kFaKeoKYNi

I hope you are enjoying your summer 🍸⛱️

— Julian Bilcke (@flngr) July 28, 2025

Because open source AI video is back 💪

Wan2.2 is out!✨ pic.twitter.com/9feAXVC4Hi

Tried doing a wall punching effect using the new Wan2.2 open source model. @Alibaba_Wan @ComfyUI pic.twitter.com/PGKoZmpuso

— enigmatic_e (@8bit_e) July 31, 2025

Tried the Veo3 annotation trick with Wan2.2 14B, 8 steps pic.twitter.com/x8Lnmcx1wg

— Linoy Tsaban (@linoy_tsaban) July 29, 2025

Co to jest WAN 2.2?

WAN 2.2 to model wideo generacyjny otwarte koda, opracowany przez akademię Damo z Alibaby. To znaczna upgrażenie do podstawowego serii modelu video WAN, zaprojektowanego do stworzenia wysokiej jakości filmowe filmowe z wskazów tekstowych i obrazu. Model jest znany ze zaawansowanych generacji ruchu i kontroli estetycznych.

Jakiej wersji są dostępne?

WAN 2.2 jest dostępny w kilku wersji z różnymi zdolnościami. Modeli otwartowego koda obejmują efektywny model TI2V-5B, który wspiera zarówno tekst-to-video (T2V) jak i Image-to-Video (I2V) w rozezolucji 720p oraz może pracować na GPU klasie konsumentów. Istnieją również potężniejsze modele 14B, takie jak T2V-A14B i i2V-A14B, które używają architekturę mieszanego ekspertu (MoE) dla wyższej jakości i wykonywania, odpowiedniej dla bardziej robotnych sprzęt.

Co to robi unikalnego?

WAN 2.2 wyróżnia się z powodu innowacyjnej architektury mieszanej ekspertów (MoE), która rozdzieluje proces odszukowania na specjalne etapy w celu lepszego wykonywania bez znacznego wzrostu kosztów obliczanych. Zawiera również kontroli estetycznych na poziomie filmowym, zdolność generowania złożonego ruchu płynnego oraz funkcji pierwszego ostatnia frame do video (FLF2V), która tworzy gładkie przejście pomiędzy dwoma obrazkami. Jego charakter otwartowego koda pozwala na dokonanie naprawdę i integrację przez społeczność.

Czy jest bezpieczne do użycia?

Jako model otwartowego koda bezpieczeństwa WAN 2.2 w dużej miejscu zależy od tego, jak jest realizowany i używany. Prowadzący ustanowili politykę użycia, która zakazuje tworzenie nielegalnych, szkodliwych lub błądliwych treści. Chociaż sam model nie ma wbudowanego systemu umierania treści, oczekuje się, że programy i platformy używające WAN 2.2 wdrożą własne gwarancje w celu zapewnienia odpowiedzialnego wykorzystania i zgodności z normami prawnych i etycznych.

Jak szybko jest?

WAN 2.2 jest wysokie optymalizowany dla prędkości, zwłaszcza jego modelu Ti2V-5B, który jest jednym z najszybszych dostępnych z rezolucją 720p i 24fps. Piętsekundne filmie można być generowane za kilka minut na GPU konsumentowym jak RTX 4090, a potężniejsze sprzęty oferujące jeszcze szybsze wyniki. Prędkość ta jest dalsze zwiększona przez efektywną architekturę mieszanego ekspertu (MoE).

Czy jest dostępny przez komórkę?

WAN 2.2 jest głównie modelem otwartem skoncentrowanym na developer. Nie ma oficjalnej, specjalnej aplikacji komórkowej od swojej producenta. Jednak ponieważ jest to otwartym koda, programowcy mogą je zintegrować je do aplikacji internetowych przyjaznych do komórkowych lub stworzyć własne aplikacje Kompatibilność GPU z klasy konsumentów sprawia również bardziej dostępniejszym dla użytkowników z wysokiej stacji roboczej mobilnymi.

Co może generować lub stworzyć?

WAN 2.2 jest w stanie generować szerokie zróżnicowanie treści wideo, od reklamów krótkich formów i klip z mediami społecznych po scen i animacji. Jego możliwości obejmują tekst-to-video, obraz do obraz i obraz opartywano na obraz. Użytkowników mogą generować filmy z specyficznymi ruchami kamery, precyzyjnymi stylami estetycznymi oraz realistycznymi ruchami dla postawów i obiektów, czyni się z tym

Jak można go użyć?

Najczęściej wykorzystać WAN 2.2 jest zbiorenie pliku modelu i prowadzenie ich lokalnie na kompatibilnej maszynie, często z integracją poprzez platform takich jak Comfyui lub diffuser. W celu bardziej dostępnego doświadczenia model jest dostępny przez dostawców API chmurnych. Istnieje również szansa na darmo spróbowanie WAN 2.2 za pomocą platformy Vizard, która zapewnia interfaces online do eksperymentowania z możliwościami modelu.

WAN 2.2 – modelem wideo generacyjnego otwartego koda z Akademii Damo w Alibabi, publicznie wydany 28 lipca 2025 r. Wprowadza on architekturę mieszanego ekspertu (MoE) do modelu rozpowszechniania wideo, co znacznie poprawiła zdolność i wykonywanie modelu bez zwiększenia kosztów wyników. Model jest znaczny z powodu estetyki na poziomie filmowej, wyjścia wysokiej definicji 1080p oraz zdolności do generowania złożonego ruchu płynnego z większą kontrolowaną niż poprzednich

Tworzy złożone, płynne i naturalne ruchy w filmach, poprawiając realizm i spójność.

Szkolony na szczególnie kurowanych danych, aby produkować filmy z dokładną kontrolowaniem nad oświetleniem, kolorem i kompozicją.

Generuje filmy o rozdzielnieniu 1080p o 24fps, odpowiednie do profesjonalnego użycia.

Kontrola kamery filmowej Generuje filmy o rozdzielnieniu 1080p o 24fps, odpowiednie do profesjonalnego użycia.

Tworzy bezszczęśliwe przejście filmu poprzez interpolację pomiędzy określonym ramem

Dostępny jest wysokościowe model 5B, który może pracować na GPU konsumentów jak RTX 4090.

Model jest publicznie dostępny, pozwala na dokładną dostosowanie z LORA i innymi narzędzi opracowanych przez wspólnoty.

Oto trzy proste kroki, które pomogą ci badać WAN 2.2 na Vizard:

Idź do tekstu Vizard do generator video i wybierz model WAN 2.2.

Wedłuż swój proszę lub złożć obraz, aby zacząć.

Po gotowie nagrania można go zawierać lub podzielić się na kontach społecznych bezpośrednio przez Vizard.

Wan2.2 The quality is significantly improved, tested some human body performance. Amazing@Alibaba_Wan #wan2.2 pic.twitter.com/ptUXlOS1Ka

— TTPlanet (@ttplanet) July 28, 2025

Fun workflow I was playing with last night

— A.I.Warper (@AIWarper) August 8, 2025

1) Kontext to remove Thor from the shot

2) Photopea to place Shrek

3) Kontext + Relight lora to blend him into the shot

4) Wan2.2 i2V to animate

Very addicting... 😍

Prompts are written up in the corner. Wan 2.2 prompt below 👇 pic.twitter.com/EnWE2OgA7T

Wan2.2(I2V) works pretty good.(Base image is not AI generated.) pic.twitter.com/5g9CfoiqT4

— Xiu Ran (@f_fanshu) July 30, 2025

You can’t skate here sir..

— Ingi Erlingsson 🪄 (@ingi_erlingsson) August 5, 2025

Wan2.2 @Alibaba_Wan + @ComfyUI 🛹 pic.twitter.com/kFaKeoKYNi

I hope you are enjoying your summer 🍸⛱️

— Julian Bilcke (@flngr) July 28, 2025

Because open source AI video is back 💪

Wan2.2 is out!✨ pic.twitter.com/9feAXVC4Hi

Tried doing a wall punching effect using the new Wan2.2 open source model. @Alibaba_Wan @ComfyUI pic.twitter.com/PGKoZmpuso

— enigmatic_e (@8bit_e) July 31, 2025

Tried the Veo3 annotation trick with Wan2.2 14B, 8 steps pic.twitter.com/x8Lnmcx1wg

— Linoy Tsaban (@linoy_tsaban) July 29, 2025

Co to jest WAN 2.2?

WAN 2.2 to model wideo generacyjny otwarte koda, opracowany przez akademię Damo z Alibaby. To znaczna upgrażenie do podstawowego serii modelu video WAN, zaprojektowanego do stworzenia wysokiej jakości filmowe filmowe z wskazów tekstowych i obrazu. Model jest znany ze zaawansowanych generacji ruchu i kontroli estetycznych.

Jakiej wersji są dostępne?

WAN 2.2 jest dostępny w kilku wersji z różnymi zdolnościami. Modeli otwartowego koda obejmują efektywny model TI2V-5B, który wspiera zarówno tekst-to-video (T2V) jak i Image-to-Video (I2V) w rozezolucji 720p oraz może pracować na GPU klasie konsumentów. Istnieją również potężniejsze modele 14B, takie jak T2V-A14B i i2V-A14B, które używają architekturę mieszanego ekspertu (MoE) dla wyższej jakości i wykonywania, odpowiedniej dla bardziej robotnych sprzęt.

Co to robi unikalnego?

WAN 2.2 wyróżnia się z powodu innowacyjnej architektury mieszanej ekspertów (MoE), która rozdzieluje proces odszukowania na specjalne etapy w celu lepszego wykonywania bez znacznego wzrostu kosztów obliczanych. Zawiera również kontroli estetycznych na poziomie filmowym, zdolność generowania złożonego ruchu płynnego oraz funkcji pierwszego ostatnia frame do video (FLF2V), która tworzy gładkie przejście pomiędzy dwoma obrazkami. Jego charakter otwartowego koda pozwala na dokonanie naprawdę i integrację przez społeczność.

Czy jest bezpieczne do użycia?

Jako model otwartowego koda bezpieczeństwa WAN 2.2 w dużej miejscu zależy od tego, jak jest realizowany i używany. Prowadzący ustanowili politykę użycia, która zakazuje tworzenie nielegalnych, szkodliwych lub błądliwych treści. Chociaż sam model nie ma wbudowanego systemu umierania treści, oczekuje się, że programy i platformy używające WAN 2.2 wdrożą własne gwarancje w celu zapewnienia odpowiedzialnego wykorzystania i zgodności z normami prawnych i etycznych.

Jak szybko jest?

WAN 2.2 jest wysokie optymalizowany dla prędkości, zwłaszcza jego modelu Ti2V-5B, który jest jednym z najszybszych dostępnych z rezolucją 720p i 24fps. Piętsekundne filmie można być generowane za kilka minut na GPU konsumentowym jak RTX 4090, a potężniejsze sprzęty oferujące jeszcze szybsze wyniki. Prędkość ta jest dalsze zwiększona przez efektywną architekturę mieszanego ekspertu (MoE).

Czy jest dostępny przez komórkę?

WAN 2.2 jest głównie modelem otwartem skoncentrowanym na developer. Nie ma oficjalnej, specjalnej aplikacji komórkowej od swojej producenta. Jednak ponieważ jest to otwartym koda, programowcy mogą je zintegrować je do aplikacji internetowych przyjaznych do komórkowych lub stworzyć własne aplikacje Kompatibilność GPU z klasy konsumentów sprawia również bardziej dostępniejszym dla użytkowników z wysokiej stacji roboczej mobilnymi.

Co może generować lub stworzyć?

WAN 2.2 jest w stanie generować szerokie zróżnicowanie treści wideo, od reklamów krótkich formów i klip z mediami społecznych po scen i animacji. Jego możliwości obejmują tekst-to-video, obraz do obraz i obraz opartywano na obraz. Użytkowników mogą generować filmy z specyficznymi ruchami kamery, precyzyjnymi stylami estetycznymi oraz realistycznymi ruchami dla postawów i obiektów, czyni się z tym

Jak można go użyć?

Najczęściej wykorzystać WAN 2.2 jest zbiorenie pliku modelu i prowadzenie ich lokalnie na kompatibilnej maszynie, często z integracją poprzez platform takich jak Comfyui lub diffuser. W celu bardziej dostępnego doświadczenia model jest dostępny przez dostawców API chmurnych. Istnieje również szansa na darmo spróbowanie WAN 2.2 za pomocą platformy Vizard, która zapewnia interfaces online do eksperymentowania z możliwościami modelu.