New

마케팅 담당자

팀이

비디오를 규모로 만들 수 있도록 강화합니다.

기관

용이한 규모 비디오 제작

플랫폼별로

wan 2.2는 알리바바 다모 아카데미의 오픈 소스 생성 ai 비디오 모델로 2025년 7월 28일에 공개되었습니다. 그것은 동영상 확산 모델에 전문가 혼합(MoE) 아키텍처를 도입하여 추론 비용을 증가시키지 않고 모델 용량과 성능을 현저하게 향상시킨다. 이 모델은 영화 수준의 미적, 고화질 1080p 출력, 이전 모델보다 더 큰 제어를 가진 복잡하고 유동적인 운동을 생성할 수 있는 능력으로 유명하다.

wan 2.2는 알리바바 다모 아카데미의 오픈 소스 생성 ai 비디오 모델로 2025년 7월 28일에 공개되었습니다. 그것은 동영상 확산 모델에 전문가 혼합(MoE) 아키텍처를 도입하여 추론 비용을 증가시키지 않고 모델 용량과 성능을 현저하게 향상시킨다. 이 모델은 영화 수준의 미적, 고화질 1080p 출력, 이전 모델보다 더 큰 제어를 가진 복잡하고 유동적인 운동을 생성할 수 있는 능력으로 유명하다.

비디오에서 복잡하고 유동하며 자연스러운 움직임을 만들어 현실성과 일관성을 향상시킨다.

조명, 색상, 구성을 정확하게 제어할 수 있는 비디오를 만들기 위해 정교하게 정렬된 데이터에 대해 훈련을 받았습니다.

전문적인 사용에 적합한 24fps에서 기본 1080p 해상도를 가진 비디오를 생성합니다.

영화 카메라 제어 전문적인 사용에 적합한 24fps에서 기본 1080p 해상도의 비디오를 생성합니다.

지정된 시작 프레임 및 끝 프레임 사이에 보간하여 원활한 비디오 전환을 생성합니다.

고도로 압축된 5b 모델은 rtx 4090처럼 소비자 gpus에서 실행할 수 있다.

이 모델은 공개적으로 사용할 수 있어 lora 및 기타 커뮤니티에서 개발한 도구를 사용하여 미세 조정할 수 있다.

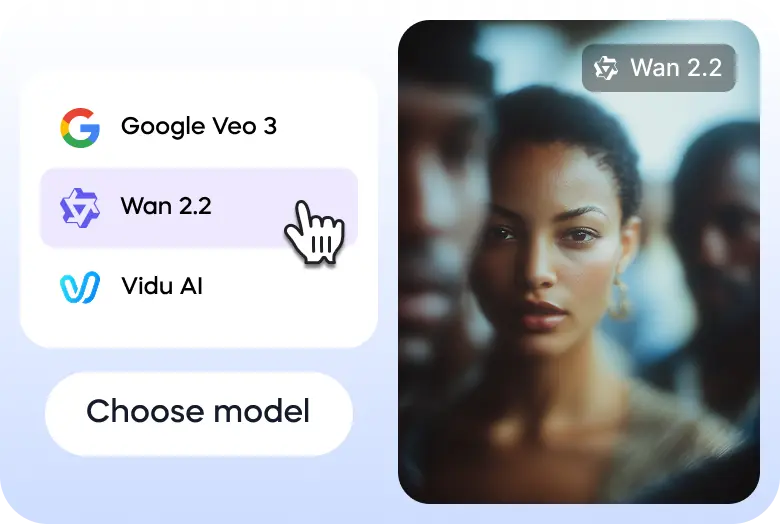

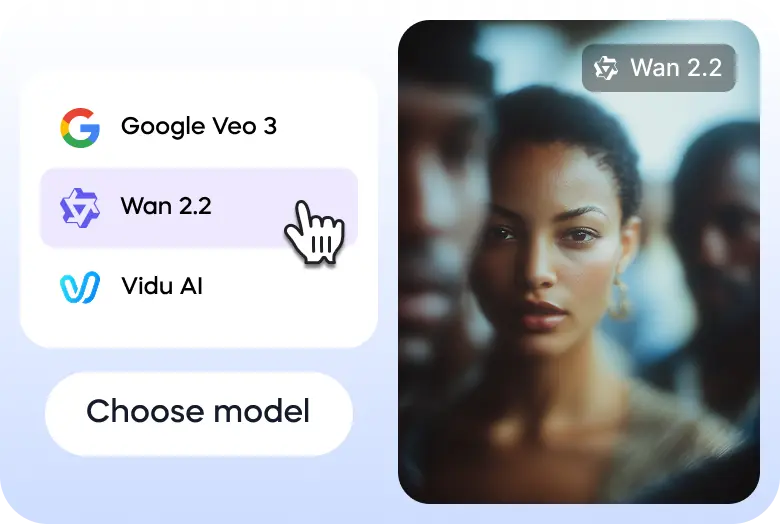

vizard에서 wan 2.2를 탐색할 수 있는 세 가지 간단한 단계는 다음과 같습니다.

vizard의 텍스트로 동영상 생성기로 이동하고 wan 2.2 모델을 선택합니다.

프롬프트를 입력하거나 이미지를 업로드하여 시작하십시오.

비디오가 준비되면 vizard를 통해 직접 소셜 미디어 계정에서 다운로드하거나 공유할 수 있습니다.

Wan2.2 The quality is significantly improved, tested some human body performance. Amazing@Alibaba_Wan #wan2.2 pic.twitter.com/ptUXlOS1Ka

— TTPlanet (@ttplanet) July 28, 2025

Fun workflow I was playing with last night

— A.I.Warper (@AIWarper) August 8, 2025

1) Kontext to remove Thor from the shot

2) Photopea to place Shrek

3) Kontext + Relight lora to blend him into the shot

4) Wan2.2 i2V to animate

Very addicting... 😍

Prompts are written up in the corner. Wan 2.2 prompt below 👇 pic.twitter.com/EnWE2OgA7T

Wan2.2(I2V) works pretty good.(Base image is not AI generated.) pic.twitter.com/5g9CfoiqT4

— Xiu Ran (@f_fanshu) July 30, 2025

You can’t skate here sir..

— Ingi Erlingsson 🪄 (@ingi_erlingsson) August 5, 2025

Wan2.2 @Alibaba_Wan + @ComfyUI 🛹 pic.twitter.com/kFaKeoKYNi

I hope you are enjoying your summer 🍸⛱️

— Julian Bilcke (@flngr) July 28, 2025

Because open source AI video is back 💪

Wan2.2 is out!✨ pic.twitter.com/9feAXVC4Hi

Tried doing a wall punching effect using the new Wan2.2 open source model. @Alibaba_Wan @ComfyUI pic.twitter.com/PGKoZmpuso

— enigmatic_e (@8bit_e) July 31, 2025

Tried the Veo3 annotation trick with Wan2.2 14B, 8 steps pic.twitter.com/x8Lnmcx1wg

— Linoy Tsaban (@linoy_tsaban) July 29, 2025

wan 2.2는 무엇입니까?

wan 2.2는 알리바바의 다모 아카데미가 개발한 최첨단 오픈 소스 생성 AI 비디오 모델이다. 이것은 텍스트와 이미지 프롬프트에서 고품질의 영화 동영상을 만들기 위해 설계된 기본 wan 비디오 모델 시리즈의 주요 업그레이드입니다. 이 모델은 고급 모션 생성과 미적 제어로 유명하다.

어떤 버전을 사용할 수 있습니까?

wan 2.2는 다양한 기능을 가진 여러 버전에서 사용할 수 있습니다. 핵심 오픈 소스 모델에는 720p 해상도의 텍스트 대 비디오 T2V 및 이미지 대 비디오 I2V 모두를 지원하며 소비자 등급 gpus에서 실행할 수 있는 효율적인 ti2v-5b 모델이 포함된다. 또한 t2v-a14b와 i2v-a14b와 같은 더욱 강력한 14b 모델이 있는데, 이 모델들은 더욱 강력한 하드웨어에 적합한 품질과 성능을 위해 전문가 혼합(MoE) 아키텍처를 사용한다.

무엇이 그것을 독특하게 만들었습니까?

wan 2.2는 혁신적인 전문가 혼합(MoE) 아키텍처로 두드러지며, 노이즈 제거 과정을 전문적인 단계로 분리하여 계산 비용을 크게 증가시키지 않고 성능을 향상시킨다. 또한 영화 수준의 미적 제어, 복잡하고 유동적인 운동을 생성할 수 있는 기능, 두 개의 이미지 사이에 부드러운 전환을 만드는 첫 번째 프레임에서 비디오(FLF2V) 기능을 갖추고 있다. 그것의 오픈 소스 성격은 커뮤니티에 의한 미세 조정과 통합을 허용합니다.

안전하게 사용하십니까?

오픈 소스 모델로서 wan 2.2의 안전성은 그것이 어떻게 구현되고 사용되는지에 크게 달려 있다. 개발자들은 불법, 유해 또는 오도적인 콘텐츠의 생성을 금지하는 사용 정책을 수립했다. 모델 자체에는 콘텐츠 조정 시스템이 내장되어 있지 않지만, wan 2.2를 사용하는 개발자와 플랫폼은 책임있는 사용과 법률과 윤리 기준의 준수를 보장하기 위해 자체 보장 조치를 구현할 것으로 기대된다.

얼마나 빨라요?

wan 2.2는 속도에 매우 최적화되어 있으며, 특히 720p 해상도와 24fps에서 가장 빠른 모델 중 하나인 ti2v-5b 모델입니다. rtx 4090과 같은 소비자 gpu에서 5초의 비디오를 몇 분 만에 생성할 수 있으며, 더 강력한 하드웨어는 더욱 빠른 결과를 제공합니다. 효율적인 전문가 혼합(MoE) 아키텍처로 속도가 더욱 향상되었다.

모바일을 통해 액세스할 수 있습니까?

wan 2.2는 주로 개발자 중심의 오픈 소스 모델입니다. 그것은 제작자의 공식 전용 모바일 앱이 없습니다. 그러나 개발자들은 오픈 소스이기 때문에 모바일 친화적인 웹 애플리케이션에 통합하거나 자신만의 모바일 앱을 만들 수 있다. 또한 고급 모바일 워크스테이션을 사용하는 사용자들이 더 쉽게 액세스할 수 있도록 소비자 등급의 gpu 호환성을 제공합니다.

그것은 무엇을 생성하거나 만들 수 있습니까?

wan 2.2는 짧은 광고와 소셜 미디어 클립에서 영화 장면과 애니메이션에 이르기까지 다양한 비디오 콘텐츠를 생성할 수 있다. 그것의 기능에는 텍스트 대 비디오, 이미지 대 비디오, 그리고 이미지 기반 그림이 포함됩니다. 사용자는 특정 카메라 동작, 정확한 미적 스타일, 캐릭터와 물체에 대한 사실적인 동작을 가진 비디오를 생성할 수 있어 기술 프로젝트와 창의적인 프로젝트를 위한 다용도 도구가 될 수 있다.

어떻게 사용할 수 있습니까?

wan 2.2를 사용하는 가장 일반적인 방법은 모델 파일을 다운로드하고 호환되는 시스템에서 로컬로 실행하는 것입니다. 종종 comfyui 또는 디파이저와 같은 플랫폼을 통해 통합됩니다. 이 모델은 클라우드 API 공급업체를 통해 보다 액세스할 수 있는 경험을 제공합니다. 또한 vizard 플랫폼을 통해 wan 2.2를 무료로 시도할 수 있는 기회가 있는데, 이 플랫폼은 모델의 기능을 실험할 수 있는 온라인 인터페이스를 제공한다.

wan 2.2는 알리바바 다모 아카데미의 오픈 소스 생성 ai 비디오 모델로 2025년 7월 28일에 공개되었습니다. 그것은 동영상 확산 모델에 전문가 혼합(MoE) 아키텍처를 도입하여 추론 비용을 증가시키지 않고 모델 용량과 성능을 현저하게 향상시킨다. 이 모델은 영화 수준의 미적, 고화질 1080p 출력, 이전 모델보다 더 큰 제어를 가진 복잡하고 유동적인 운동을 생성할 수 있는 능력으로 유명하다.

비디오에서 복잡하고 유동하며 자연스러운 움직임을 만들어 현실성과 일관성을 향상시킨다.

조명, 색상, 구성을 정확하게 제어할 수 있는 비디오를 만들기 위해 정교하게 정렬된 데이터에 대해 훈련을 받았습니다.

전문적인 사용에 적합한 24fps에서 기본 1080p 해상도를 가진 비디오를 생성합니다.

영화 카메라 제어 전문적인 사용에 적합한 24fps에서 기본 1080p 해상도의 비디오를 생성합니다.

지정된 시작 프레임 및 끝 프레임 사이에 보간하여 원활한 비디오 전환을 생성합니다.

고도로 압축된 5b 모델은 rtx 4090처럼 소비자 gpus에서 실행할 수 있다.

이 모델은 공개적으로 사용할 수 있어 lora 및 기타 커뮤니티에서 개발한 도구를 사용하여 미세 조정할 수 있다.

vizard에서 wan 2.2를 탐색할 수 있는 세 가지 간단한 단계는 다음과 같습니다.

vizard의 텍스트로 동영상 생성기로 이동하고 wan 2.2 모델을 선택합니다.

프롬프트를 입력하거나 이미지를 업로드하여 시작하십시오.

비디오가 준비되면 vizard를 통해 직접 소셜 미디어 계정에서 다운로드하거나 공유할 수 있습니다.

Wan2.2 The quality is significantly improved, tested some human body performance. Amazing@Alibaba_Wan #wan2.2 pic.twitter.com/ptUXlOS1Ka

— TTPlanet (@ttplanet) July 28, 2025

Fun workflow I was playing with last night

— A.I.Warper (@AIWarper) August 8, 2025

1) Kontext to remove Thor from the shot

2) Photopea to place Shrek

3) Kontext + Relight lora to blend him into the shot

4) Wan2.2 i2V to animate

Very addicting... 😍

Prompts are written up in the corner. Wan 2.2 prompt below 👇 pic.twitter.com/EnWE2OgA7T

Wan2.2(I2V) works pretty good.(Base image is not AI generated.) pic.twitter.com/5g9CfoiqT4

— Xiu Ran (@f_fanshu) July 30, 2025

You can’t skate here sir..

— Ingi Erlingsson 🪄 (@ingi_erlingsson) August 5, 2025

Wan2.2 @Alibaba_Wan + @ComfyUI 🛹 pic.twitter.com/kFaKeoKYNi

I hope you are enjoying your summer 🍸⛱️

— Julian Bilcke (@flngr) July 28, 2025

Because open source AI video is back 💪

Wan2.2 is out!✨ pic.twitter.com/9feAXVC4Hi

Tried doing a wall punching effect using the new Wan2.2 open source model. @Alibaba_Wan @ComfyUI pic.twitter.com/PGKoZmpuso

— enigmatic_e (@8bit_e) July 31, 2025

Tried the Veo3 annotation trick with Wan2.2 14B, 8 steps pic.twitter.com/x8Lnmcx1wg

— Linoy Tsaban (@linoy_tsaban) July 29, 2025

wan 2.2는 무엇입니까?

wan 2.2는 알리바바의 다모 아카데미가 개발한 최첨단 오픈 소스 생성 AI 비디오 모델이다. 이것은 텍스트와 이미지 프롬프트에서 고품질의 영화 동영상을 만들기 위해 설계된 기본 wan 비디오 모델 시리즈의 주요 업그레이드입니다. 이 모델은 고급 모션 생성과 미적 제어로 유명하다.

어떤 버전을 사용할 수 있습니까?

wan 2.2는 다양한 기능을 가진 여러 버전에서 사용할 수 있습니다. 핵심 오픈 소스 모델에는 720p 해상도의 텍스트 대 비디오 T2V 및 이미지 대 비디오 I2V 모두를 지원하며 소비자 등급 gpus에서 실행할 수 있는 효율적인 ti2v-5b 모델이 포함된다. 또한 t2v-a14b와 i2v-a14b와 같은 더욱 강력한 14b 모델이 있는데, 이 모델들은 더욱 강력한 하드웨어에 적합한 품질과 성능을 위해 전문가 혼합(MoE) 아키텍처를 사용한다.

무엇이 그것을 독특하게 만들었습니까?

wan 2.2는 혁신적인 전문가 혼합(MoE) 아키텍처로 두드러지며, 노이즈 제거 과정을 전문적인 단계로 분리하여 계산 비용을 크게 증가시키지 않고 성능을 향상시킨다. 또한 영화 수준의 미적 제어, 복잡하고 유동적인 운동을 생성할 수 있는 기능, 두 개의 이미지 사이에 부드러운 전환을 만드는 첫 번째 프레임에서 비디오(FLF2V) 기능을 갖추고 있다. 그것의 오픈 소스 성격은 커뮤니티에 의한 미세 조정과 통합을 허용합니다.

안전하게 사용하십니까?

오픈 소스 모델로서 wan 2.2의 안전성은 그것이 어떻게 구현되고 사용되는지에 크게 달려 있다. 개발자들은 불법, 유해 또는 오도적인 콘텐츠의 생성을 금지하는 사용 정책을 수립했다. 모델 자체에는 콘텐츠 조정 시스템이 내장되어 있지 않지만, wan 2.2를 사용하는 개발자와 플랫폼은 책임있는 사용과 법률과 윤리 기준의 준수를 보장하기 위해 자체 보장 조치를 구현할 것으로 기대된다.

얼마나 빨라요?

wan 2.2는 속도에 매우 최적화되어 있으며, 특히 720p 해상도와 24fps에서 가장 빠른 모델 중 하나인 ti2v-5b 모델입니다. rtx 4090과 같은 소비자 gpu에서 5초의 비디오를 몇 분 만에 생성할 수 있으며, 더 강력한 하드웨어는 더욱 빠른 결과를 제공합니다. 효율적인 전문가 혼합(MoE) 아키텍처로 속도가 더욱 향상되었다.

모바일을 통해 액세스할 수 있습니까?

wan 2.2는 주로 개발자 중심의 오픈 소스 모델입니다. 그것은 제작자의 공식 전용 모바일 앱이 없습니다. 그러나 개발자들은 오픈 소스이기 때문에 모바일 친화적인 웹 애플리케이션에 통합하거나 자신만의 모바일 앱을 만들 수 있다. 또한 고급 모바일 워크스테이션을 사용하는 사용자들이 더 쉽게 액세스할 수 있도록 소비자 등급의 gpu 호환성을 제공합니다.

그것은 무엇을 생성하거나 만들 수 있습니까?

wan 2.2는 짧은 광고와 소셜 미디어 클립에서 영화 장면과 애니메이션에 이르기까지 다양한 비디오 콘텐츠를 생성할 수 있다. 그것의 기능에는 텍스트 대 비디오, 이미지 대 비디오, 그리고 이미지 기반 그림이 포함됩니다. 사용자는 특정 카메라 동작, 정확한 미적 스타일, 캐릭터와 물체에 대한 사실적인 동작을 가진 비디오를 생성할 수 있어 기술 프로젝트와 창의적인 프로젝트를 위한 다용도 도구가 될 수 있다.

어떻게 사용할 수 있습니까?

wan 2.2를 사용하는 가장 일반적인 방법은 모델 파일을 다운로드하고 호환되는 시스템에서 로컬로 실행하는 것입니다. 종종 comfyui 또는 디파이저와 같은 플랫폼을 통해 통합됩니다. 이 모델은 클라우드 API 공급업체를 통해 보다 액세스할 수 있는 경험을 제공합니다. 또한 vizard 플랫폼을 통해 wan 2.2를 무료로 시도할 수 있는 기회가 있는데, 이 플랫폼은 모델의 기능을 실험할 수 있는 온라인 인터페이스를 제공한다.