New

マーケティング担当者

チームに

ビデオを大規模に作成できるようにする

クリエイター

社会的存在感を構築することが容易になる

代理店

を簡単にビデオ制作を拡大する

Wan 2.2は、アリババのダモアカデミーのオープンソース生成AIビデオモデルで、2025年7月28日に公開されました。ビデオ拡散モデルに専門家混合(MoE)アーキテクチャを導入し、推論コストを増加させることなくモデルの容量とパフォーマンスを大幅に向上させます。このモデルは、映画レベルの美学、高精細1080p出力、以前のモデルよりも優れた制御で複雑で流動的な動きを生成する能力で注目されています。

Wan 2.2は、アリババのダモアカデミーのオープンソース生成AIビデオモデルで、2025年7月28日に公開されました。ビデオ拡散モデルに専門家混合(MoE)アーキテクチャを導入し、推論コストを増加させることなくモデルの容量とパフォーマンスを大幅に向上させます。このモデルは、映画レベルの美学、高精細1080p出力、以前のモデルよりも優れた制御で複雑で流動的な動きを生成する能力で注目されています。

ビデオに複雑で流動的で自然な動きを生み出し、リアリズムと一貫性を向上させます。

照明、色、構成を正確に制御したビデオを作成するために、細心の注意を払ったデータで訓練されました。

プロの使用に適した24fpsでネイティブ1080p解像度のビデオを生成します。

シネマティックカメラ制御 プロの使用に適した24fpsでネイティブ1080p解像度のビデオを生成します。

指定された開始フレームと終了フレームの間で補間することで、シームレスなビデオ遷移を作成します。

高度に圧縮された5Bモデルが利用可能で、RTX 4090のように消費者GPUsで動作できます。

このモデルは公開されており、LoRAやその他のコミュニティ開発ツールで微調整することができます。

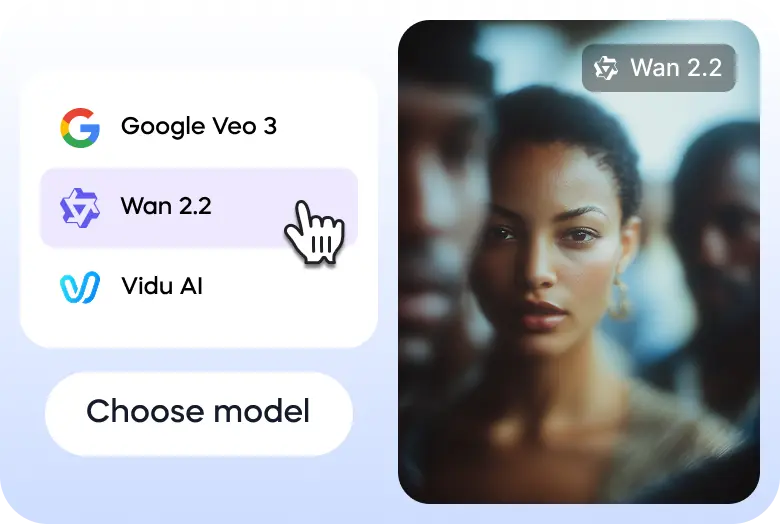

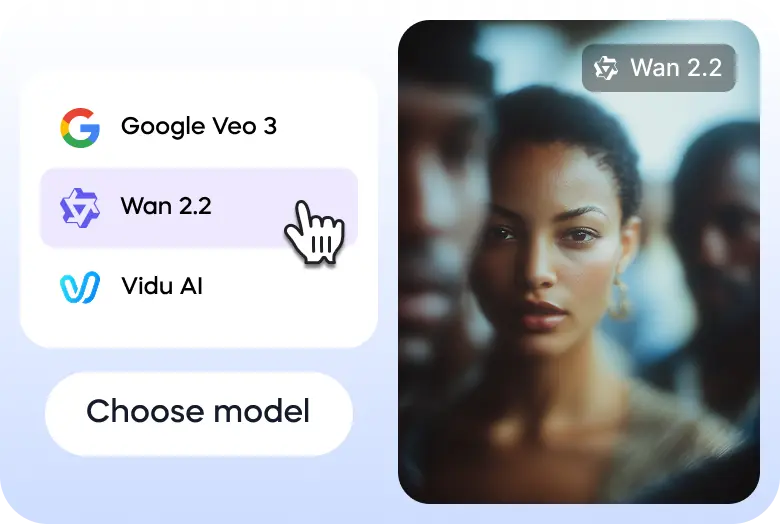

VizardでWan 2.2を探索するのに役立つ3つの簡単な手順は次のとおりです。

Vizardのテキストからビデオジェネレータに移動し、Wan 2.2モデルを選択します。

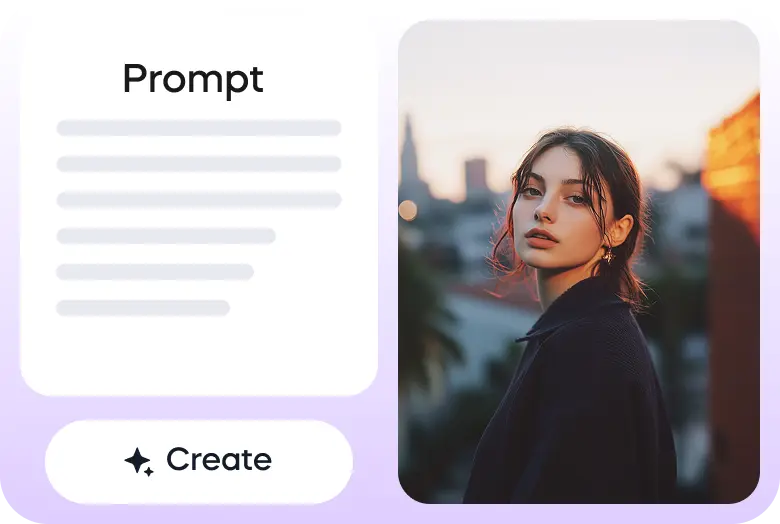

プロンプトを入力するか、画像をアップロードして開始します。

ビデオの準備ができたら、Vizardを通じてダウンロードしたり、ソーシャルメディアアカウントで直接共有したりできます。

Wan2.2 The quality is significantly improved, tested some human body performance. Amazing@Alibaba_Wan #wan2.2 pic.twitter.com/ptUXlOS1Ka

— TTPlanet (@ttplanet) July 28, 2025

Fun workflow I was playing with last night

— A.I.Warper (@AIWarper) August 8, 2025

1) Kontext to remove Thor from the shot

2) Photopea to place Shrek

3) Kontext + Relight lora to blend him into the shot

4) Wan2.2 i2V to animate

Very addicting... 😍

Prompts are written up in the corner. Wan 2.2 prompt below 👇 pic.twitter.com/EnWE2OgA7T

Wan2.2(I2V) works pretty good.(Base image is not AI generated.) pic.twitter.com/5g9CfoiqT4

— Xiu Ran (@f_fanshu) July 30, 2025

You can’t skate here sir..

— Ingi Erlingsson 🪄 (@ingi_erlingsson) August 5, 2025

Wan2.2 @Alibaba_Wan + @ComfyUI 🛹 pic.twitter.com/kFaKeoKYNi

I hope you are enjoying your summer 🍸⛱️

— Julian Bilcke (@flngr) July 28, 2025

Because open source AI video is back 💪

Wan2.2 is out!✨ pic.twitter.com/9feAXVC4Hi

Tried doing a wall punching effect using the new Wan2.2 open source model. @Alibaba_Wan @ComfyUI pic.twitter.com/PGKoZmpuso

— enigmatic_e (@8bit_e) July 31, 2025

Tried the Veo3 annotation trick with Wan2.2 14B, 8 steps pic.twitter.com/x8Lnmcx1wg

— Linoy Tsaban (@linoy_tsaban) July 29, 2025

Wan 2.2とは何ですか?

Wan 2.2は、アリババのDAMOアカデミーによって開発された最先端のオープンソース生成AIビデオモデルです。これは、テキストと画像のプロンプトから高品質で映画的なビデオを作成するように設計された基礎的なWanビデオモデルシリーズの主要なアップグレードです。このモデルは、高度なモーション生成と美的制御で知られています。

どのバージョンが利用可能ですか?

Wan 2.2は、さまざまな機能を備えたいくつかのバージョンで利用できます。コアオープンソースモデルには、テキストからビデオへの(T2V)とイメージからビデオへの(I2V)の両方を720p解像度でサポートし、消費者グレードのGPUsで動作できる効率的なTI2V-5Bモデルが含まれます。また、T2V-A14BやI2V-A14Bなど、より強力な14Bモデルもあり、より堅牢なハードウェアに適した優れた品質とパフォーマンスのために専門家の混合(MoE)アーキテクチャを使用しています。

何がそれをユニークにしていますか?

Wan 2.2は、ノイズ除去プロセスを特殊な段階に分けて、計算コストを大幅に増加させることなくパフォーマンスを向上させる革新的な専門家混合(MoE)アーキテクチャによって際立っています。また、映画レベルの美的コントロール、複雑で流動的な動きを生成する機能、2つの画像間のスムーズな遷移を生成する最初の最後のフレームからビデオへの機能(FLF2V)も備えています。そのオープンソースの性質により、コミュニティ主導の微調整と統合が可能になります。

使用するのは安全ですか?

オープンソースモデルとして、Wan 2.2の安全性は、実装および使用方法に大きく依存します。開発者は、違法、有害、または誤解を招くコンテンツの生成を禁止する使用ポリシーを確立しています。モデル自体にはコンテンツモデレーションシステムが組み込まれていませんが、Wan 2.2を使用する開発者とプラットフォームは、責任ある使用と法的および倫理的基準の遵守を確実にするために独自の保護措置を実施することが期待されています。

どのくらいの速さですか?

Wan 2.2は速度のために高度に最適化されており、特に720p解像度と24fpsで利用可能な最速の1つであるTI2V-5Bモデルです。RTX 4090のような消費者用GPUでは、5秒のビデオをわずか数分で生成でき、より強力なハードウェアによりさらに高速な結果が得られます。効率的な専門家混合(MoE)アーキテクチャにより、スピードがさらに向上します。

モバイルでアクセスできますか?

Wan 2.2は主に開発者に焦点を当てたオープンソースモデルです。プロデューサーからの公式の専用モバイルアプリはありません。ただし、オープンソースであるため、開発者はモバイルフレンドリーなwebアプリケーションに統合したり、独自のモバイルアプリを作成したりできます。また、コンシューマーグレードのGPU互換性により、ハイエンドのモバイルワークステーションを使用しているユーザーがよりアクセスしやすくなります。

それは何を生成したり、何を作成したりできますか?

Wan 2.2は、ショートフォームの広告やソーシャルメディアクリップから映画シーンやアニメーションまで、さまざまなビデオコンテンツを生成できます。その機能には、テキストからビデオへの移行、イメージからビデオへの移行、およびイメージベースのインペイントが含まれます。ユーザーは、特定のカメラの動き、正確な美的スタイル、キャラクターやオブジェクトのリアルな動きを備えたビデオを生成でき、テクニカルプロジェクトとクリエイティブプロジェクトの両方に汎用性の高いツールになります。

どのように使用できますか?

Wan 2.2を使用する最も一般的な方法は、モデルファイルをダウンロードして互換性のあるマシン上でローカルに実行することです。多くの場合、ComfyUIやディフューザーなどのプラットフォームを介して統合されます。よりアクセス可能なエクスペリエンスのために、このモデルはクラウドAPIプロバイダーを介して利用できます。モデルの機能を実験するためのオンラインインターフェースを提供するVizardプラットフォームを通じてWan 2.2を無料で試す機会もあります。

Wan 2.2は、アリババのダモアカデミーのオープンソース生成AIビデオモデルで、2025年7月28日に公開されました。ビデオ拡散モデルに専門家混合(MoE)アーキテクチャを導入し、推論コストを増加させることなくモデルの容量とパフォーマンスを大幅に向上させます。このモデルは、映画レベルの美学、高精細1080p出力、以前のモデルよりも優れた制御で複雑で流動的な動きを生成する能力で注目されています。

ビデオに複雑で流動的で自然な動きを生み出し、リアリズムと一貫性を向上させます。

照明、色、構成を正確に制御したビデオを作成するために、細心の注意を払ったデータで訓練されました。

プロの使用に適した24fpsでネイティブ1080p解像度のビデオを生成します。

シネマティックカメラ制御 プロの使用に適した24fpsでネイティブ1080p解像度のビデオを生成します。

指定された開始フレームと終了フレームの間で補間することで、シームレスなビデオ遷移を作成します。

高度に圧縮された5Bモデルが利用可能で、RTX 4090のように消費者GPUsで動作できます。

このモデルは公開されており、LoRAやその他のコミュニティ開発ツールで微調整することができます。

VizardでWan 2.2を探索するのに役立つ3つの簡単な手順は次のとおりです。

Vizardのテキストからビデオジェネレータに移動し、Wan 2.2モデルを選択します。

プロンプトを入力するか、画像をアップロードして開始します。

ビデオの準備ができたら、Vizardを通じてダウンロードしたり、ソーシャルメディアアカウントで直接共有したりできます。

Wan2.2 The quality is significantly improved, tested some human body performance. Amazing@Alibaba_Wan #wan2.2 pic.twitter.com/ptUXlOS1Ka

— TTPlanet (@ttplanet) July 28, 2025

Fun workflow I was playing with last night

— A.I.Warper (@AIWarper) August 8, 2025

1) Kontext to remove Thor from the shot

2) Photopea to place Shrek

3) Kontext + Relight lora to blend him into the shot

4) Wan2.2 i2V to animate

Very addicting... 😍

Prompts are written up in the corner. Wan 2.2 prompt below 👇 pic.twitter.com/EnWE2OgA7T

Wan2.2(I2V) works pretty good.(Base image is not AI generated.) pic.twitter.com/5g9CfoiqT4

— Xiu Ran (@f_fanshu) July 30, 2025

You can’t skate here sir..

— Ingi Erlingsson 🪄 (@ingi_erlingsson) August 5, 2025

Wan2.2 @Alibaba_Wan + @ComfyUI 🛹 pic.twitter.com/kFaKeoKYNi

I hope you are enjoying your summer 🍸⛱️

— Julian Bilcke (@flngr) July 28, 2025

Because open source AI video is back 💪

Wan2.2 is out!✨ pic.twitter.com/9feAXVC4Hi

Tried doing a wall punching effect using the new Wan2.2 open source model. @Alibaba_Wan @ComfyUI pic.twitter.com/PGKoZmpuso

— enigmatic_e (@8bit_e) July 31, 2025

Tried the Veo3 annotation trick with Wan2.2 14B, 8 steps pic.twitter.com/x8Lnmcx1wg

— Linoy Tsaban (@linoy_tsaban) July 29, 2025

Wan 2.2とは何ですか?

Wan 2.2は、アリババのDAMOアカデミーによって開発された最先端のオープンソース生成AIビデオモデルです。これは、テキストと画像のプロンプトから高品質で映画的なビデオを作成するように設計された基礎的なWanビデオモデルシリーズの主要なアップグレードです。このモデルは、高度なモーション生成と美的制御で知られています。

どのバージョンが利用可能ですか?

Wan 2.2は、さまざまな機能を備えたいくつかのバージョンで利用できます。コアオープンソースモデルには、テキストからビデオへの(T2V)とイメージからビデオへの(I2V)の両方を720p解像度でサポートし、消費者グレードのGPUsで動作できる効率的なTI2V-5Bモデルが含まれます。また、T2V-A14BやI2V-A14Bなど、より強力な14Bモデルもあり、より堅牢なハードウェアに適した優れた品質とパフォーマンスのために専門家の混合(MoE)アーキテクチャを使用しています。

何がそれをユニークにしていますか?

Wan 2.2は、ノイズ除去プロセスを特殊な段階に分けて、計算コストを大幅に増加させることなくパフォーマンスを向上させる革新的な専門家混合(MoE)アーキテクチャによって際立っています。また、映画レベルの美的コントロール、複雑で流動的な動きを生成する機能、2つの画像間のスムーズな遷移を生成する最初の最後のフレームからビデオへの機能(FLF2V)も備えています。そのオープンソースの性質により、コミュニティ主導の微調整と統合が可能になります。

使用するのは安全ですか?

オープンソースモデルとして、Wan 2.2の安全性は、実装および使用方法に大きく依存します。開発者は、違法、有害、または誤解を招くコンテンツの生成を禁止する使用ポリシーを確立しています。モデル自体にはコンテンツモデレーションシステムが組み込まれていませんが、Wan 2.2を使用する開発者とプラットフォームは、責任ある使用と法的および倫理的基準の遵守を確実にするために独自の保護措置を実施することが期待されています。

どのくらいの速さですか?

Wan 2.2は速度のために高度に最適化されており、特に720p解像度と24fpsで利用可能な最速の1つであるTI2V-5Bモデルです。RTX 4090のような消費者用GPUでは、5秒のビデオをわずか数分で生成でき、より強力なハードウェアによりさらに高速な結果が得られます。効率的な専門家混合(MoE)アーキテクチャにより、スピードがさらに向上します。

モバイルでアクセスできますか?

Wan 2.2は主に開発者に焦点を当てたオープンソースモデルです。プロデューサーからの公式の専用モバイルアプリはありません。ただし、オープンソースであるため、開発者はモバイルフレンドリーなwebアプリケーションに統合したり、独自のモバイルアプリを作成したりできます。また、コンシューマーグレードのGPU互換性により、ハイエンドのモバイルワークステーションを使用しているユーザーがよりアクセスしやすくなります。

それは何を生成したり、何を作成したりできますか?

Wan 2.2は、ショートフォームの広告やソーシャルメディアクリップから映画シーンやアニメーションまで、さまざまなビデオコンテンツを生成できます。その機能には、テキストからビデオへの移行、イメージからビデオへの移行、およびイメージベースのインペイントが含まれます。ユーザーは、特定のカメラの動き、正確な美的スタイル、キャラクターやオブジェクトのリアルな動きを備えたビデオを生成でき、テクニカルプロジェクトとクリエイティブプロジェクトの両方に汎用性の高いツールになります。

どのように使用できますか?

Wan 2.2を使用する最も一般的な方法は、モデルファイルをダウンロードして互換性のあるマシン上でローカルに実行することです。多くの場合、ComfyUIやディフューザーなどのプラットフォームを介して統合されます。よりアクセス可能なエクスペリエンスのために、このモデルはクラウドAPIプロバイダーを介して利用できます。モデルの機能を実験するためのオンラインインターフェースを提供するVizardプラットフォームを通じてWan 2.2を無料で試す機会もあります。